Colossus Dibuka: xAI Beri Anthropic Akses Superkomputer Raksasa

xAI mengumumkan kemitraan dengan Anthropic untuk memberikan akses ke Colossus 1, salah satu superkomputer AI terbesar dan tercepat di dunia, guna meningkatkan pelatihan dan pengoperasian model Claude. Superkomputer ini ditenagai lebih dari 220.000 GPU NVIDIA.

Dalam langkah yang mengejutkan industri AI, xAI mengumumkan kemitraan komputasi strategis dengan Anthropic. Melalui kesepakatan ini, Anthropic akan mendapatkan akses langsung ke Colossus 1 — superkomputer AI yang termasuk salah satu yang terbesar dan paling cepat diterapkan di dunia. Infrastruktur ini ditenagai oleh lebih dari 220.000 GPU NVIDIA dan diharapkan secara fundamental meningkatkan kapasitas pelatihan serta inferensi model Claude. Kemitraan ini menandai babak baru dalam kolaborasi antar laboratorium AI frontier, di mana kapasitas komputasi tidak lagi menjadi keunggulan tertutup melainkan aset yang dapat dibagikan untuk akselerasi kemajuan bersama.

Pengumuman ini disampaikan bersamaan dengan acara Code w/ Claude 2026 di San Francisco, di mana Anthropic juga mengungkapkan bahwa lalu lintas API mereka tumbuh 17 kali lipat secara tahunan. CEO Nvidia Jensen Huang secara terpisah menyampaikan selamat atas kolaborasi ini, menegaskan bahwa masa depan AI berjalan di atas infrastruktur NVIDIA. Bagi Anthropic, akses ke Colossus 1 berarti Claude dapat menangani beban kerja yang jauh lebih besar, mempercepat siklus riset dan pengembangan model generasi berikutnya.

OpenAI, AMD, dan Nvidia Luncurkan Protokol Jaringan Baru MRC

OpenAI bersama AMD, Broadcom, Intel, Microsoft, dan Nvidia merilis protokol jaringan sumber terbuka Multipath Reliable Connection (MRC), yang bertujuan meningkatkan kecepatan dan keandalan klaster pelatihan AI skala besar serta mengurangi waktu idle GPU.

Protokol MRC dirancang khusus untuk menjawab tantangan mendasar dalam pelatihan model AI berskala masif: menjaga ribuan GPU tetap sinkron melalui jaringan yang andal. Dengan menyediakan koneksi multipath yang tangguh, MRC secara signifikan mengurangi waktu GPU yang terbuang akibat kegagalan jaringan — masalah kronis dalam klaster pelatihan besar. OpenAI telah menggunakan protokol ini secara internal untuk pelatihan ChatGPT dan kini membukanya untuk seluruh komunitas. Kolaborasi enam perusahaan teknologi terkemuka ini menegaskan bahwa infrastruktur AI semakin menjadi prioritas bersama yang melampaui batas persaingan antar perusahaan.

Perplexity Kembangkan Mesin Inferensi ROSE Milik Sendiri

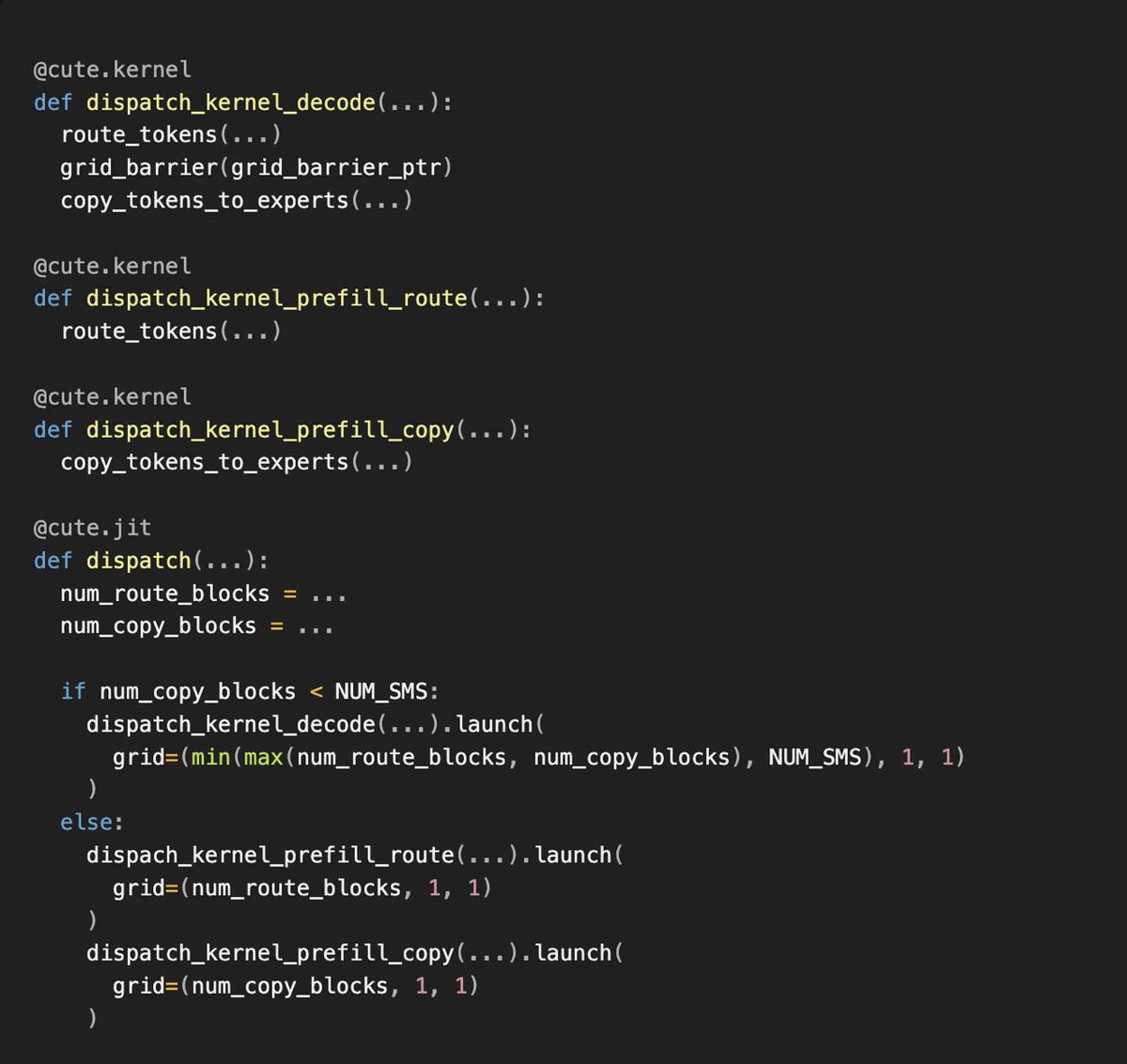

Perplexity mengembangkan mesin inferensi sendiri bernama ROSE (Runtime-Optimized Serving Engine), yang mampu melayani model dari embedding hingga LLM triliunan parameter. Dengan mengintegrasikan CuTeDSL ke dalam mesin inferensi, Perplexity dapat membangun kernel GPU khusus secara lebih cepat, memangkas waktu dari riset ke produksi.

Mesin inferensi buatan sendiri ini menandai langkah strategis Perplexity menuju kemandirian infrastruktur, mengurangi ketergantungan pada penyedia inferensi pihak ketiga dan memungkinkan optimasi yang lebih dalam untuk model-model yang mereka layani.

Nvidia dan ServiceNow Kirimkan Agen AI Otonom Perusahaan

Nvidia bermitra dengan ServiceNow untuk mengirimkan agen AI yang dapat bertindak secara otonom dalam alur kerja perusahaan, dengan kemampuan tata kelola, audit, dan eksekusi keamanan bawaan. Di konferensi ServiceNow Knowledge 2026, ServiceNow memperkenalkan Project Arc.

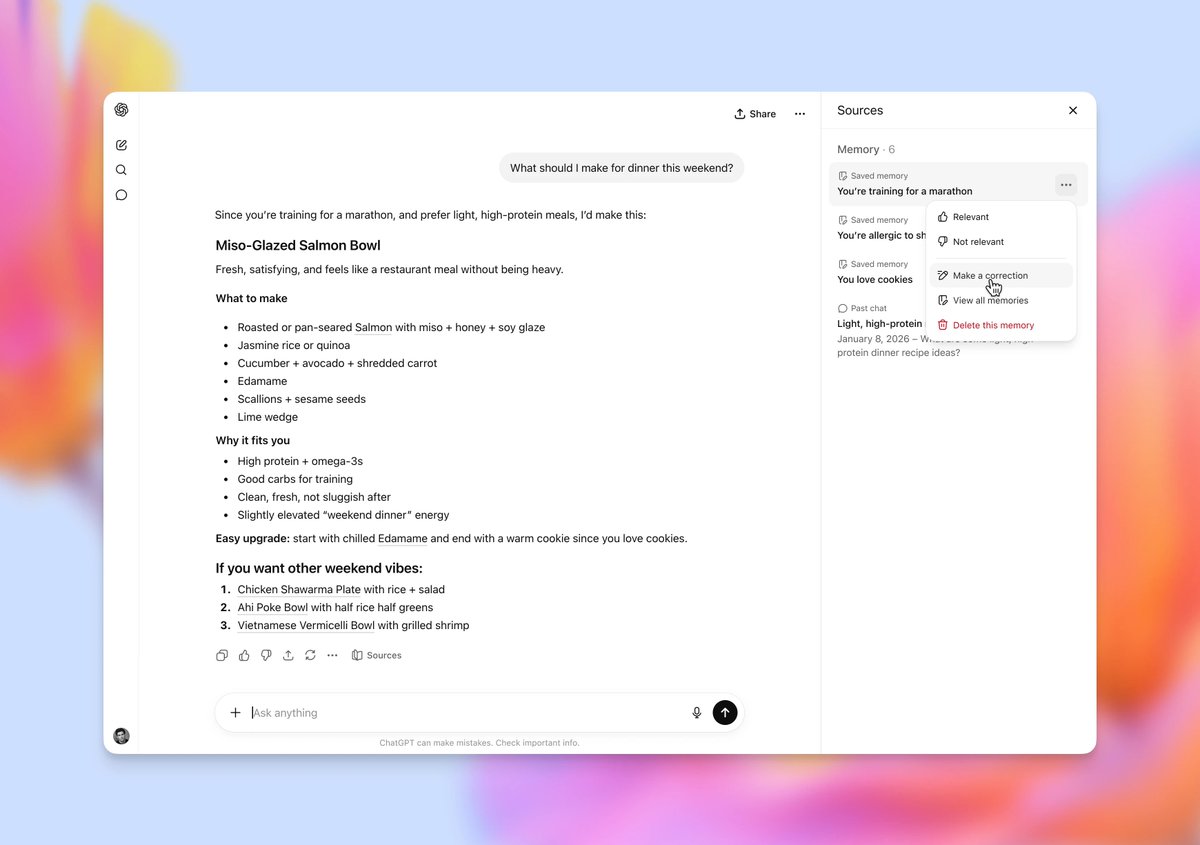

Claude Managed Agents: Orkestrasi Multi-Agen dan Pembelajaran Mandiri

Anthropic meluncurkan serangkaian fitur baru dalam Claude Managed Agents, mencakup orkestrasi multi-agen, putaran perbaikan diri berbasis rubrik (Outcomes), dan "Dreaming" — mekanisme pembelajaran mandiri yang memungkinkan agen belajar dari data historis. Webhooks juga ditambahkan untuk integrasi yang lebih luas dengan sistem eksternal.

Anthropic Tingkatkan Batas Claude Code dan Kecepatan API

Anthropic mengumumkan peningkatan signifikan pada batas penggunaan: batas 5 jam Claude Code digandakan untuk paket Pro, Max, Team, dan Enterprise per kursi. Pembatasan jam sibuk pada Claude Code untuk paket Pro dan Max dihapus sepenuhnya. Selain itu, batas kecepatan API untuk model Opus ditingkatkan secara substansial. Semua perubahan berlaku efektif segera.

"Kemitraan ini tampaknya menjadi pukulan bagi gagasan bahwa Grok akan tetap menjadi model terdepan. xAI kini lebih memilih menyewakan kapasitas komputasinya daripada mengejar frontier." Ethan Mollick

Google DeepMind Bermitra dengan EVE Online untuk Riset AI

Google DeepMind mengumumkan kemitraan dengan pengembang EVE Online untuk menggunakan alam semesta kompleks yang digerakkan pemain sebagai kotak pasir yang aman guna menguji memori, pembelajaran berkelanjutan, dan perencanaan jangka panjang agen AI. Dunia EVE yang masif dan digerakkan pemain menyediakan lingkungan yang ideal untuk mengeksplorasi batas kemampuan agen AI dalam skenario multi-agen yang realistis.

OpenAI Buka Sumber Protokol MRC yang Digunakan untuk Melatih ChatGPT

Protokol MRC yang telah digunakan OpenAI untuk melatih ChatGPT kini resmi menjadi sumber terbuka. Dikembangkan bersama AMD, Broadcom, Intel, Microsoft, dan Nvidia, protokol ini menjanjikan peningkatan efisiensi signifikan pada klaster pelatihan AI skala besar. Dengan membuka MRC, OpenAI berharap ekosistem AI yang lebih luas dapat memanfaatkan dan mengembangkannya.

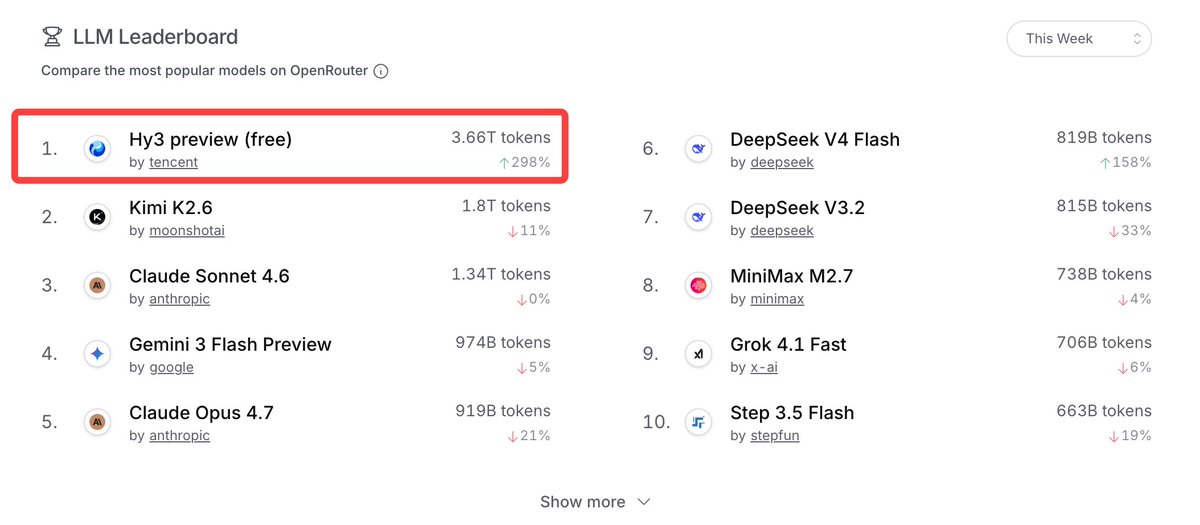

Tencent Hunyuan Hy3 Preview Puncaki Grafik Mingguan OpenRouter

Dua minggu setelah dirilis, Hy3 Preview memproses 3,66 triliun token dengan peningkatan mingguan 298%, menempati peringkat pertama dalam penggunaan keseluruhan, pemanggilan alat, dan pengkodean. Pangsa pasar mencapai 15,4% di seluruh penyedia.

Hugging Face Luncurkan Toko Aplikasi Robot Sumber Terbuka

Hugging Face meluncurkan toko aplikasi sumber terbuka untuk robot Reachy Mini, berisi lebih dari 200 aplikasi. Platform ini bertujuan menurunkan hambatan pengembangan robotika dengan memungkinkan pengguna mengunduh aplikasi seperti layaknya toko aplikasi ponsel.

Live Blog Code w/ Claude: API Tumbuh 17x Lipat, Tanpa Model Baru

Dalam acara Code w/ Claude 2026, Anthropic mengungkapkan pertumbuhan lalu lintas API sebesar 17 kali lipat YoY. Meski tidak mengumumkan model baru, perusahaan memperkenalkan fitur multi-agen, Outcomes, dan Dreaming. Simon Willison melaporkan langsung dari San Francisco.

Cursor Gunakan Composer Lama untuk Melatih Generasi Berikutnya

Cursor mengungkapkan bahwa sistem autoinstall mereka menggunakan Composer generasi sebelumnya untuk menyiapkan lingkungan pengembangan RL. Pendekatan bootstrap ini memungkinkan model baru fokus pada pemecahan masalah yang lebih sulit.

GPT-5.5 Instant Kini Jadi Model Default ChatGPT

OpenAI memperbarui GPT-5.5 Instant dengan penurunan tingkat halusinasi signifikan di bidang hukum, keuangan, dan kedokteran. Kemampuan pemahaman gambar dan penguraian dokumen juga ditingkatkan. Model ini sekarang menjadi default di ChatGPT.

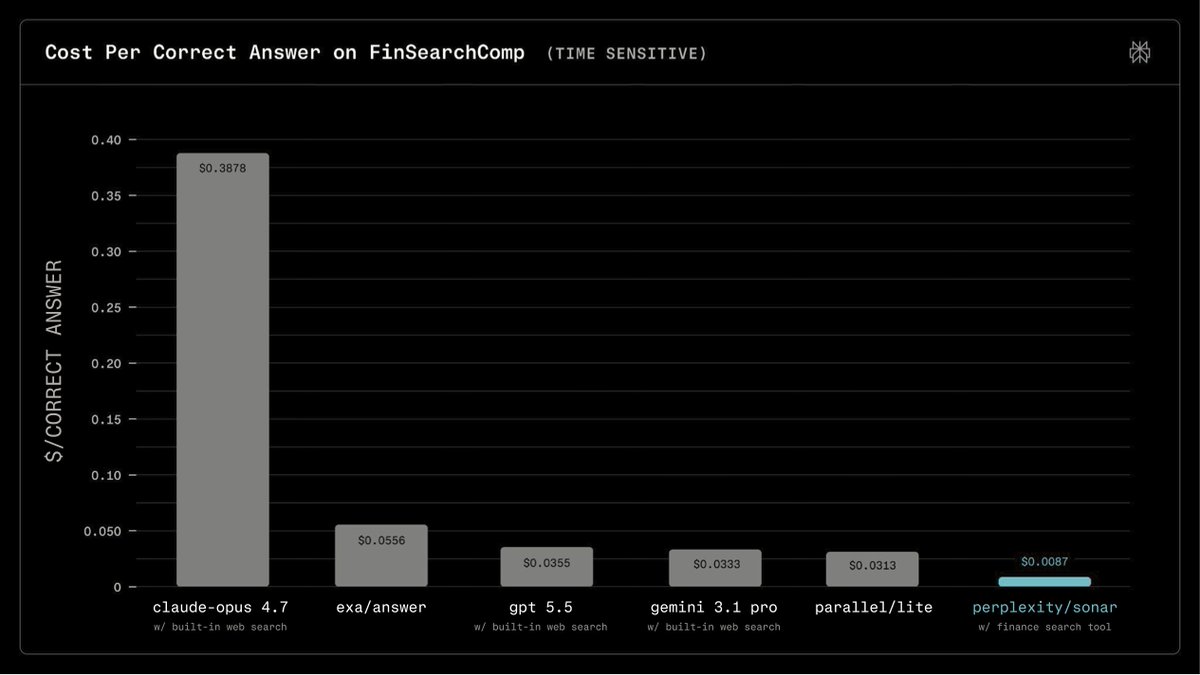

Perplexity Agent API Kini Dukung Pencarian Finansial

Developer dapat mengambil data keuangan berlisensi, data pasar real-time, dan sumber web terverifikasi dalam satu panggilan alat melalui Perplexity Agent API. Fitur ini dirancang bagi agen yang memerlukan jawaban finansial terkini dan terverifikasi.

ZAYA1-8B: Model Inferensi MoE Arsitektur SoTA

Zyphra merilis ZAYA1-8B dengan arsitektur DSMoE-MLA++, RL canggih, dan test-time scaling. Model 80B direncanakan menyusul.

Pimpinan Teknik Anthropic Kelola Ratusan Agen dari Ponsel

Boris Cherny menjalankan 5-10 sesi dan ratusan agen dari ponsel; ribuan agen beroperasi malam hari untuk tugas mendalam lewat fitur "Loop".

SVGS: Warna Bervariasi Spasial Tingkatkan Gaussian Splatting

Warna dan opasitas bervariasi spasial pada setiap primitif Gaussian menggantikan warna tunggal, menghasilkan sintesis tampilan baru yang unggul.

LLM Konteks Panjang Gagal di Atas 200.000 Token

OBLIQ-Bench mengungkapkan tidak ada LLM konteks panjang yang berfungsi baik melampaui batas 200.000 token.

Model Late Interaction 0,1B Kalahkan Model Padat Jauh Lebih Besar

Model 0,1 miliar parameter LightOn mengungguli model padat yang beberapa kali lipat lebih besar di OBLIQ-Bench. Masih ada ruang besar menuju 91% nDCG.

Cursor 3.3 Visualisasikan Penggunaan Konteks Agen

Statistik penggunaan konteks agen kini terlihat, memungkinkan diagnosis konteks dan optimasi pengaturan rules, skills, MCP, dan subagen.

MiMo 2.5 Pro dan GLM 5.1 Ungguli DeepSeek dan Kimi

MiMo 2.5 Pro dan GLM 5.1 mencetak hasil impresif di evaluasi terbaru, mengungguli DeepSeek dan Kimi secara konsisten.

V4-Pro Diduga Hasil Distilasi dari Flash-Based Experts

Analisis berspekulasi bahwa DeepSeek V4-Pro disuling dari V4-Flash, bukan sebaliknya, menjelaskan performa keduanya yang hampir identik.

Anthropic Gandeng SpaceX, Naikkan Batas Claude Code dan API

Kemitraan komputasi dengan SpaceX diumumkan bersamaan dengan peningkatan batas penggunaan: Claude Code 5 jam digandakan, batas jam sibuk dihapus, dan batas API Opus dinaikkan secara signifikan.

DeepSeek Dapat Dana Negara via Posisi di Ekosistem Semikonduktor

Dengan memposisikan DeepSeek sebagai bagian dari ekosistem perangkat keras semikonduktor, Liang Wenfeng berhasil mengamankan pendanaan negara sekaligus mempertahankan otonomi riset AI.

Microsoft Gaia2: Benchmark Agen LLM di Lingkungan Dinamis

Microsoft Research meluncurkan Gaia2, benchmark yang menguji agen LLM dalam lingkungan dinamis dan asinkron dengan kendala waktu, derau, dan kolaborasi multi-agen. GPT-5 skor tertinggi 42% pass@1.

V4-Pro dan V4-Flash: Performa Hampir Identik di Berbagai Eval

Evaluasi jamak menunjukkan V4-Pro dan V4-Flash nyaris identik. Sebagai perbandingan: GLM 5.1 (58,1), MiMo 2.5 Pro (66,4), GPT 5.5 (77,8).

Model Sumber Terbuka Capai 81,8% di SWE-Bench Verified

Sebuah model sumber terbuka mencapai 81,8% di SWE-Bench Verified setelah modifikasi mekanisme atensi, memicu diskusi komunitas.

RLVE: Lingkungan Adaptif untuk Pelatihan RL Model Bahasa

Lingkungan RLVE diadopsi dalam pipeline pelatihan ZAYA1 Zyphra, menghasilkan peningkatan rata-rata 3,37% di enam benchmark penalaran pada model 1,5B.