xAI、ColossusスーパーコンピュータをAnthropicに開放

220,000基以上のNVIDIA GPUを搭載する世界最大級のAIスパコンColossus 1が、Claudeの学習と推論を加速する。AI業界に衝撃が走った大型提携の全貌。

xAIはAnthropicとの新たな計算資源提携を発表した。xAIが保有する世界最大級のAIスーパーコンピュータ「Colossus 1」へのアクセスをAnthropicに提供し、Claudeモデルのトレーニングと運用能力を強化する。Colossus 1には220,000基以上のNVIDIA GPUが搭載されており、NVIDIAも「AIの未来はNVIDIA上で動く」と公式に祝福した。一方で、この提携はxAI自身のGrokがもはやフロンティアモデルであり続けるかという疑問も投げかけている。業界関係者からは「Grokの戦略的後退を示唆する」との見方も出ている。

OpenAI、AMD、NVIDIAらと新ネットワークプロトコルMRCを発表

大規模AIトレーニングクラスターの信頼性を向上させ、GPUアイドル時間を削減するオープンソースプロトコル。

OpenAIはAMD、Broadcom、Intel、Microsoft、NVIDIAと協力し、オープンソースのネットワークプロトコル「MRC(Multipath Reliable Connection)」を公開した。MRCは超大規模AIスーパーコンピュータが同期を維持するために設計され、多数のチップ間でデータを確実かつ効率的に転送する。OpenAIの研究者らは「この規模で同期を保つには新しい種類のネットワークが必要だった」と述べている。

Anthropic、Claude Codeの使用制限とAPIレートを大幅引き上げ

5時間制限が2倍に、ピーク時制限も撤廃。OpusモデルのAPIレートも大幅増。

AnthropicはClaude Codeの5時間ローリング制限をPro、Max、Teamおよびシート単位のEnterpriseプランで倍増させた。ProとMaxプランのピーク時速度制限も撤廃。さらにOpusモデルのAPIレート制限を大幅に引き上げた。この発表は「Code w/ Claude」イベントでのAPIトラフィック前年比17倍増の発表と同時に行われ、急速な需要拡大を背景とした計算能力強化の一環と見られる。

Claude Managed Agentsにマルチエージェント機能と自己学習が登場

複数エージェントの協調、ルーブリック駆動の自己改善、Dreaming機能を搭載。

AnthropicはClaude Managed Agentsにマルチエージェントオーケストレーションを追加した。複数のエージェントが協調して複雑なタスクを処理できるようになり、Outcomesループによるルーブリック駆動の自己改善、自己学習のためのDreaming機能、そして外部サービスとの連携を可能にするwebhooksも実装された。これにより、Claudeエージェントは自律的にパフォーマンスを最適化できるようになる。

Perplexity、独自推論エンジンROSEを開発

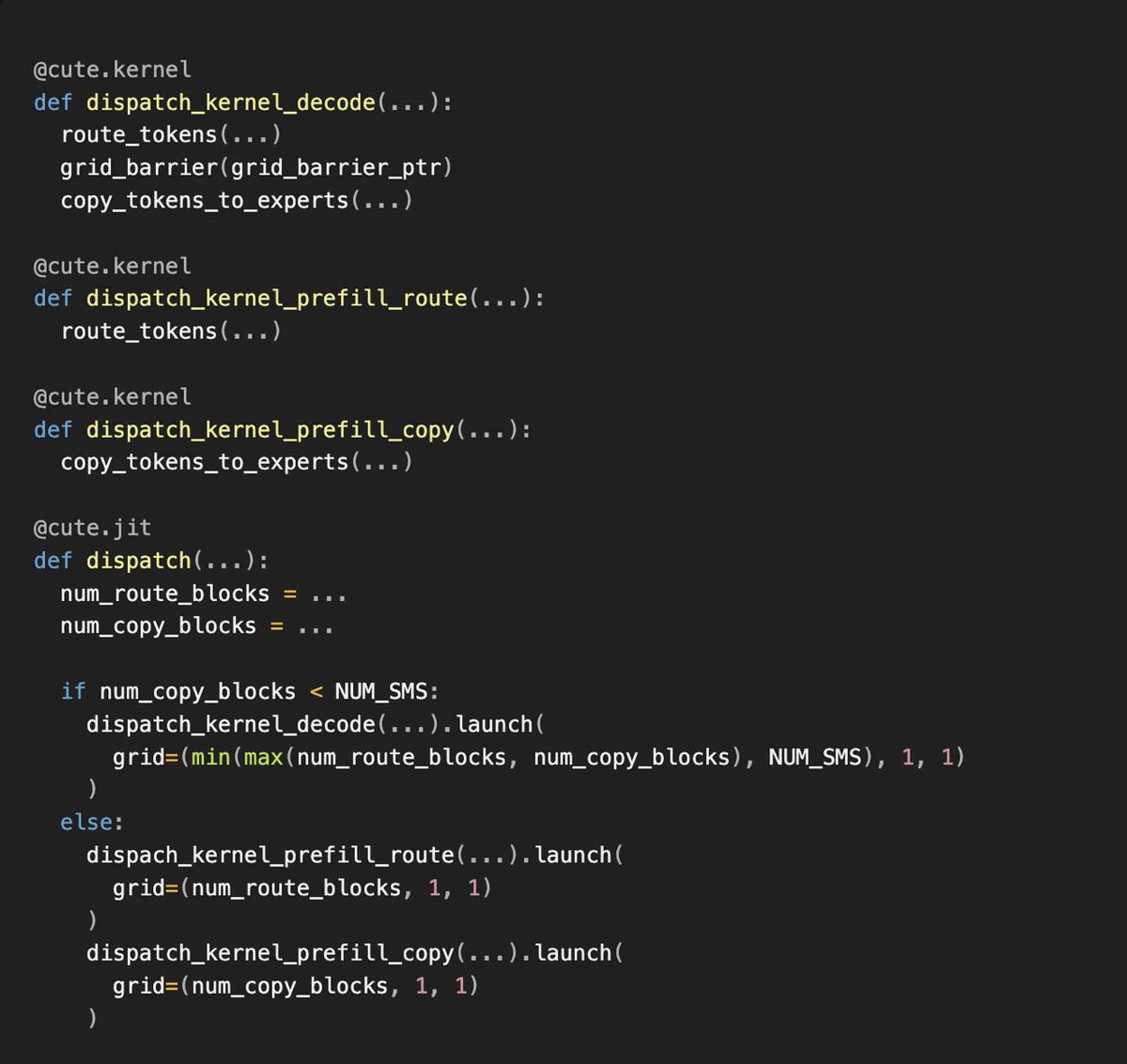

埋め込みモデルから兆パラメータLLMまで、CuTeDSL統合でGPUカーネル構築を高速化。

Perplexityは独自の推論エンジン「ROSE(Runtime-Optimized Serving Engine)」を開発した。ROSEは埋め込みモデルから1兆パラメータ規模のLLMまで幅広く対応し、CuTeDSLを統合することで専門的なGPUカーネルの構築を高速化する。これにより、Perplexityは外部推論サービスへの依存を減らし、自社インフラでのモデル提供能力を大幅に強化した。

「AnthropicのAPIトラフィックは前年比17倍に成長。Code w/ Claude 2026では、SpaceXとのColossusデータセンター提携と、マルチエージェントオーケストレーション、Outcomes、Dreamingの3つの新機能が発表された。」

— Simon Willison、Code w/ Claude 2026 基調講演ライブブログより

Google DeepMind、EVE Onlineと提携しAI研究へ

Google DeepMindはEVE Onlineの開発者と提携し、プレイヤー主導の複雑な宇宙をサンドボックスとして利用。AIエージェントの記憶、継続学習、長期計画能力をテストする。

Tencent Hunyuan Hy3がOpenRouter週間チャートで首位に

リリースから2週間で3.66兆トークンを処理、週間298%増。総使用量、ツール呼び出し、コーディングの全カテゴリで1位を獲得。市場シェアは15.4%に達した。

Hugging Face、ロボット向けオープンソースアプリストアを公開

Reachy Miniロボット向けに200以上のアプリを収録したアプリストアを公開。ロボット開発の敷居を下げ、スマートフォン感覚で機能追加できるエコシステムを目指す。

NVIDIAとServiceNow、エンタープライズ自律AIエージェントを提供

ガバナンス、監査、セキュリティ実行機能を備えたAIエージェントをエンタープライズワークフローに統合。ServiceNow Knowledge 2026で長期稼働デスクトップエージェント「Project Arc」も発表。

OpenAI、ChatGPTトレーニング用MRCプロトコルをオープンソース化

ChatGPTの訓練に実際に使用されたネットワークプロトコルMRCが一般公開された。大規模AIトレーニングクラスターの効率を飛躍的に向上させる設計で、業界全体への波及効果が期待される。

Anthropicエンジニアリング責任者、仕事の大半をスマホで完結

Boris Cherny氏はClaudeアプリ内に常時5〜10セッション、数百のエージェントを常駐させ、夜間には数千のエージェントが深層タスクを実行する「Loop」運用を実践している。

Cursor、旧世代Composerで次世代モデルのRL訓練環境を自動構築

Cursorの自動インストールシステムは、先行バージョンのComposerモデルを使ってRL訓練用の開発環境を自動セットアップ。新世代モデルはより困難な問題の学習に専念できる。

Zyphra、ZAYA1-8B推論モデルを発表

DSMoE-MLA++アーキテクチャを採用し、ハイエンドRLとテスト時スケーリングを組み合わせた推論特化型MoEモデル。RLVE環境が訓練パイプラインに採用されており、80B版も準備中。

OpenAI、GPT-5.5 InstantをChatGPTのデフォルトモデルに

法律、金融、医療分野でのハルシネーション率が顕著に低下。画像理解と文書解析能力も向上し、リアルタイム精度と日常タスクのパフォーマンスが改善された。

vLLM × Mooncake、エージェントワークロードの大規模配信を実現

エージェントトレースが80K+トークンに達し、94%以上のプレフィックスが再利用可能な環境で、分散KVキャッシュによりインスタンス間ルーティングの課題を解決。

vLLM、LightSeekのMLAライブラリを統合

Tokenspeedプロジェクトの独占ローンチパートナーとして、Kimi 2.5/2.6とDeepSeek R1向けに最適化されたMLAライブラリを統合。長文脈・マルチターンのエージェントワークロードに対応。

MSR、動的・非同期環境向けLLMエージェント評価ベンチマークGaia2を発表

時間制約、ノイズ、動的イベント、マルチエージェント協調を含む現実的な環境でエージェントを評価。GPT-5が総合42%で最高スコアを獲得したが、時間制約タスクには課題が残る。

Cursor 3.3、エージェントのコンテキスト使用状況を可視化

ルール、スキル、MCP、サブエージェントにわたるコンテキスト使用量の詳細な内訳を表示。コンテキスト問題の診断と設定の最適化が容易になった。

Perplexity Agent APIに金融検索機能を追加

1回のツール呼び出しで認可された金融データセット、リアルタイム市場データ、引用付きウェブソースを取得可能。検証可能な金融回答が必要なエージェント向け。

xAIとAnthropicの提携、Grokの戦略的位置づけに影響か

業界アナリストからは、xAIが競合にスパコンを開放することはGrokがフロンティアモデルであり続ける意思を弱めた可能性を示唆するとの指摘が上がっている。

OBLIQ-Benchが示す長文脈LLMの限界

20万トークンを超えると、あらゆる長文脈LLMが機能しなくなることを示す最も自然なタスクとして注目されている。

LightOnの0.1Bモデルが大規模モデルを凌駕

わずか0.1Bパラメータの後期相互作用モデルがOBLIQ-Benchで桁違いに大きな密モデルを上回ったが、現在のスコアは8% nDCG@10で、91%まで伸びしろがある。

Luma、Uni-1.1 APIをリリース

トークン単位ではなく「ブリーフ(概要)」単位で推論するAPI。ファッション、建築、漫画など多様な分野で映画品質の出力を実現し、プロンプトエンジニアリング不要。

BunのGitHubボットrobobun、創設者の貢献数を超える

Code w/ CodeでBunのJarred Sumner氏が明かしたところによると、GitHubボットrobobunのBunプロジェクトへの貢献数が彼自身を上回った。

MiMo 2.5 ProとGLM 5.1がベンチマークで躍進

最新評価でMiMo 2.5 ProとGLM 5.1がDeepSeekやKimiを上回る結果を示した。GLM 5.1は58.1、MiMo 2.5 Proは66.4、GPT 5.5は77.8を記録。

DeepSeek V4-Pro、Flash版から蒸留か

V4-ProはFlashベースのエキスパートから蒸留された可能性が高いとの分析。V3.2では128K超のコンテキストをサポートできず、教師モデルはFlash以外に考えにくい。

DeepSeek V4-ProとV4-Flash、複数評価でほぼ同一性能

複数のベンチマークでV4-ProとV4-Flashのスコアがほぼ一致。DeepSeek自身の論文も「V4-Flash-Maxは複数ベンチマークでV4-Pro-Maxに匹敵する」と認めている。

Attention改変後もSWE-Benchで81.8%を記録するモデルは?

アテンション機構を分解・再構成した後でもSWE-Bench Verifiedで81.8%を達成できるオープンソースモデルを問う投稿がコミュニティで話題に。

SVGS:空間変化色でガウシアンスプラッティングを強化

各ガウスプリミティブに空間変化する色と不透明度関数を導入し、従来の単一色を置き換え。新規視点合成の品質を大幅に向上させた。

RLVE環境がZAYA1の訓練パイプラインに採用

適応型検証可能環境RLVEがZyphraのZAYA1訓練パイプラインに統合。プログラムによる問題生成とアルゴリズム検証可能報酬で動的難易度調整を実現。

NVIDIA、22万GPU搭載Colossus 1を祝福

NVIDIAはSpaceXとAnthropicの計算資源提携を祝福。Colossus 1に搭載された220,000以上のNVIDIA GPUがAIの未来を支えると表明した。

OBLIQ-Bench:情報検索の最も野心的なベンチマーク

MS MARCOとBEIR以来の停滞を打破する、過去最大級のIRベンチマークが登場。情報検索技術の新たな進展を促す。

Luma Agents、オーディエンス定義から自動広告生成

対象オーディエンスの定義とコンテンツバリエーションの設定だけで、全バージョンのターゲット広告を自動生成するクリエイティブエージェント機能。

DeepSeek梁文鋒、ハードウェア戦略で資金と自律性を獲得か

DeepSeekを半導体ハードウェアプロジェクトの一部と位置づけることで、国家資金とAI研究の自律性の両方を確保した可能性が指摘されている。