OpenAI, AMD e Nvidia lançam novo protocolo de rede MRC

OpenAI, em parceria com AMD, Broadcom, Intel, Microsoft e Nvidia, lançou o protocolo de rede de código aberto MRC, que visa aumentar a velocidade e a confiabilidade de grandes clusters de treinamento de IA e reduzir o tempo ocioso da GPU.

A OpenAI abriu o código do protocolo de rede MRC que utiliza para treinar o ChatGPT. Desenvolvido em conjunto com AMD, Broadcom, Intel, Microsoft e Nvidia, o Multipath Reliable Connection promete acelerar o treinamento de modelos em clusters com centenas de milhares de GPUs. Ao reduzir a latência e melhorar a confiabilidade das conexões entre nós de computação, o protocolo ataca um dos maiores gargalos no treinamento de grandes modelos de linguagem. A iniciativa representa uma colaboração sem precedentes entre os principais fabricantes de chips e a OpenAI para resolver desafios de infraestrutura de rede em escala. Os engenheiros da OpenAI afirmam que supercomputadores de IA precisam de um novo tipo de rede para permanecer em sincronia em escala massiva, e o MRC é a resposta para transportar dados de forma confiável entre um número recorde de chips.

xAI abre Colossus para Anthropic

A xAI anunciou parceria com a Anthropic para fornecer acesso ao Colossus 1, supercomputador equipado com mais de 220 mil GPUs NVIDIA, para aprimorar o treinamento do modelo Claude. A colaboração levanta questões sobre o futuro do Grok como modelo de fronteira.

Claude Managed Agents ganha orquestração multiagente e autoaprendizagem

A Anthropic lançou novos recursos no Claude Managed Agents, incluindo orquestração multiagente, ciclos de autoaperfeiçoamento baseados em regras, autoaprendizagem conhecida como "Dreaming" e webhooks. Agora múltiplos agentes Claude podem coordenar tarefas complexas e melhorar seu desempenho de forma autônoma, com milhares de agentes executando tarefas profundas durante a noite. O chefe de engenharia Boris Cherny revelou que gerencia a maior parte do trabalho pelo celular, com centenas de agentes ativos em sessões.

Perplexity revela motor de inferência próprio ROSE

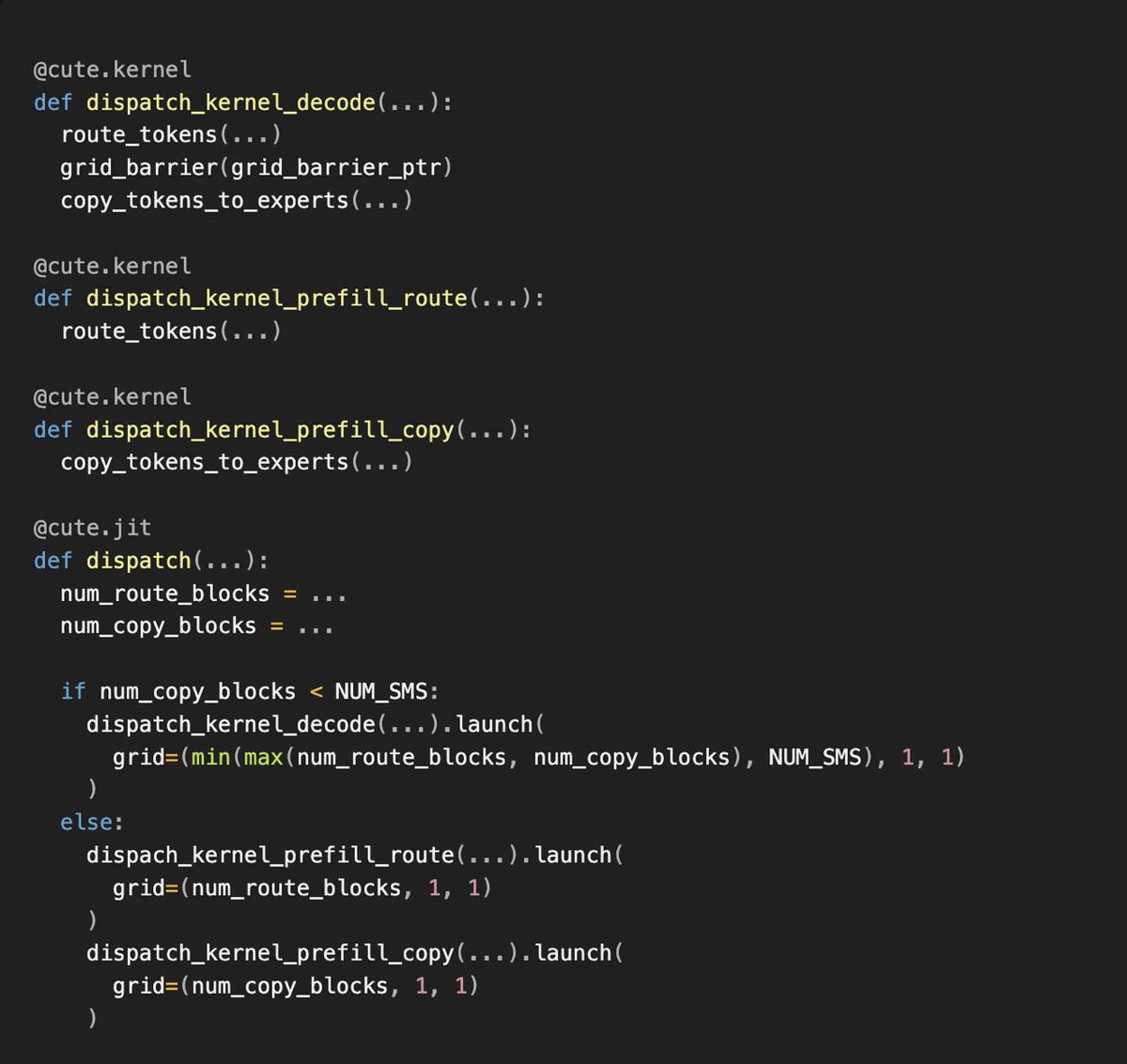

A Perplexity desenvolveu seu próprio mecanismo de inferência, ROSE, capaz de atender desde modelos de incorporação até LLMs de trilhões de parâmetros. O motor integra o CuTeDSL para acelerar a construção de kernels de GPU, permitindo que a empresa sirva modelos com mais eficiência e menor latência, reduzindo a dependência de fornecedores externos de infraestrutura de inferência.

Anthropic dobra limites do Claude Code e remove restrições de horário

A Anthropic dobrou o limite de 5 horas do Claude Code para assinantes Pro, Max, Team e Enterprise, removeu a limitação de horário de pico e aumentou significativamente os limites de taxa da API para o modelo Opus. A API da empresa cresceu 17 vezes em relação ao ano anterior. As mudanças entram em vigor imediatamente e refletem a demanda explosiva por capacidade de computação para agentes de IA.

Google DeepMind testa agentes no universo de EVE Online

O Google DeepMind firmou parceria com a desenvolvedora de EVE Online para usar seu complexo universo dirigido por jogadores como ambiente de testes para avaliar memória, aprendizado contínuo e planejamento de longo prazo de agentes de IA. O mundo persistente e imprevisível do jogo oferece um campo de provas ideal para agentes autônomos em cenários realistas e dinâmicos.

Supercomputadores de IA precisam de um novo tipo de rede para permanecer em sincronia em escala massiva. O MRC é a resposta para mover dados de forma confiável entre um número recorde de chips.

OpenAI

Nvidia e ServiceNow entregam agentes de IA autônomos

A Nvidia fez parceria com a ServiceNow para entregar agentes de IA que agem autonomamente em fluxos de trabalho empresariais, com governança, auditoria e execução segura integradas.

Hugging Face lança loja de apps para robôs

A Hugging Face lançou loja de aplicativos de código aberto para o robô Reachy Mini, com mais de 200 apps, reduzindo a barreira de entrada no desenvolvimento robótico.

Tencent Hy3 lidera ranking semanal do OpenRouter

O Tencent Hunyuan Hy3 Preview processou 3,66 trilhões de tokens, alta de 298%, liderando em uso geral, chamadas de ferramentas e codificação no OpenRouter.

Luma lança Uni-1.1 com raciocínio por briefs

A Luma lançou a API Uni-1.1, que raciocina compreendendo briefs em vez de tokens, gerando resultados de qualidade cinematográfica em moda, arquitetura e quadrinhos.

GPT-5.5 Instant torna-se modelo padrão do ChatGPT

A OpenAI atualizou o GPT-5.5 Instant como modelo padrão, reduzindo alucinações em direito, finanças e medicina, e melhorando a compreensão de imagens e documentos.

Perplexity adiciona busca financeira à Agent API

O novo recurso permite obter dados financeiros licenciados, cotações em tempo real e fontes verificadas da web em uma única chamada de ferramenta.

Luma Agents geram anúncios segmentados automaticamente

Os agentes criativos da Luma definem audiências, geram variações e otimizam campanhas de forma autônoma, cobrindo todas as etapas da produção criativa.

Cursor 3.3 mostra uso de contexto do agente

O novo painel de diagnóstico ajuda desenvolvedores a otimizar regras, skills e subagentes com base no consumo de contexto do modelo.

Robô GitHub do Bun já contribui mais que o fundador

O robobun, bot do projeto Bun, ultrapassou Jarred Sumner em número de contribuições, demonstrando o potencial de agentes autônomos no desenvolvimento de software.

Microsoft lança Gaia2 para avaliar agentes LLM

O Gaia2 é um benchmark focado em ambientes dinâmicos e assíncronos, exigindo que agentes lidem com restrições de tempo, ruído e eventos em evolução. O GPT-5 obteve a maior pontuação geral com 42% de aprovação, mas teve dificuldades em tarefas sensíveis ao tempo.

OBLIQ-Bench redefine a avaliação de recuperação de informação

O novo benchmark é considerado a tarefa mais natural para demonstrar que nenhum LLM de contexto longo funciona além de 200 mil tokens. Modelos pequenos de 0.1B parâmetros da LightOn superaram modelos muito maiores.

vLLM integra Mooncake para cargas de trabalho com agentes

A integração resolve o problema de caches KV locais descartando prefixos reutilizáveis em contextos de 80 mil tokens, com 94% de aproveitamento de prefixos.

vLLM é parceiro exclusivo do Tokenspeed da LightSeek

A biblioteca MLA da LightSeek foi otimizada para cargas de trabalho com agentes em contextos longos, compatível com Kimi 2.5/2.6 e DeepSeek R1 em GPUs NVIDIA.

Cursor usa modelos anteriores para treinar os próximos

O sistema autoinstall do Cursor utiliza versões antigas do Composer para configurar ambientes de RL, permitindo que novas gerações foquem em problemas mais complexos.

SVGS aprimora Gaussian Splatting com cores espaciais

O método introduz funções de cor e opacidade que variam espacialmente para cada primitiva gaussiana, melhorando a síntese de novas vistas em comparação com abordagens tradicionais.

ZAYA1-8B: arquitetura DSMoE-MLA++ com RL avançado

Modelo de raciocínio MoE de 8B parâmetros combina aprendizado por reforço e escalonamento em tempo de teste.

Ambientes RLVE adotados no pipeline do ZAYA1

O método de ambientes verificáveis adaptativos melhora a generalização de raciocínio ao ajustar dinamicamente a dificuldade.

MiMo 2.5 Pro e GLM 5.1 superam DeepSeek e Kimi

Resultados impressionantes colocam MiMo e GLM à frente em várias avaliações de desempenho de modelos.

V4-Pro pode ser destilado do V4-Flash

Análise sugere que o modelo Pro foi destilado a partir dos especialistas Flash, explicando desempenho similar.

V4-Pro e V4-Flash mostram desempenho quase idêntico

Em múltiplos testes, os dois modelos da DeepSeek obtiveram resultados virtualmente iguais, levantando questões sobre a diferenciação.

Modelo open source atinge 81.8% no SWE-Bench

Comunidade debate qual modelo aberto mantém alto desempenho em engenharia de software após modificações de atenção.

Wenfeng posiciona DeepSeek para obter financiamento

Estratégia vincula a empresa ao ecossistema de hardware, garantindo recursos estatais e autonomia em IA.

Boris Cherny gerencia centenas de agentes pelo celular

Chefe de engenharia da Anthropic usa Claude App com até 10 sessões e milhares de agentes noturnos em tarefas profundas.

Colossus 1: 220 mil GPUs NVIDIA impulsionam parceria SpaceX e Anthropic

A Nvidia parabenizou a SpaceX e a Anthropic pela nova parceria de computação, revelando que o supercomputador Colossus 1 é alimentado por mais de 220 mil GPUs NVIDIA. O cluster, operado pela xAI, está entre os maiores e mais rápidos já implantados para treinamento de IA. Observadores notam que a decisão da xAI de ceder capacidade à concorrente Anthropic pode sinalizar que o modelo Grok não será mais priorizado como modelo de fronteira, com a empresa redirecionando esforços para infraestrutura como serviço.