xAI Luncurkan Fitur Kloning Suara Grok Voice API

xAI merilis fitur kloning suara untuk Grok Voice API, yang memungkinkan kloning suara dengan emosi alami dari rekaman pendek. Pengelolaan pustaka suara dilakukan melalui konsol xAI, membuka kustomisasi suara merek yang dipersonalisasi. Fitur ini telah tersedia dan menargetkan brand yang ingin menghadirkan identitas suara khas dalam interaksi AI.

Ollama Dukung Claude Desktop, Buka Inferensi Pihak Ketiga

Ollama kini mendukung semua model di Ollama Cloud melalui fitur inferensi pihak ketiga bawaan Claude Desktop. Pengguna dapat menjalankan Claude Cowork dan Claude Code dengan model dari ekosistem Ollama, membuka interoperabilitas antara platform inferensi lokal dan asisten kode berbasis cloud Anthropic.

Vercel Luncurkan Orkestrator Agen Sumber Terbuka deepsec untuk Tinjauan Keamanan Mendalam

CEO Vercel mengumumkan peluncuran deepsec, orkestrator agen sumber terbuka yang dirancang untuk tinjauan keamanan mendalam. Alat ini dibangun untuk penggunaan internal, dan setelah berhasil mengidentifikasi kerentanan kritis di beberapa proyek OSS besar, tim Vercel memutuskan untuk membagikannya kepada publik. deepsec memungkinkan agen koding menemukan celah keamanan yang sebelumnya luput dari audit manual, menandai langkah penting dalam otomatisasi keamanan perangkat lunak berbasis AI.

Perplexity Computer Terintegrasi dengan Microsoft Teams

Perplexity Computer kini tersedia di dalam Microsoft Teams, memungkinkan pengguna melakukan riset, analisis, dan pembuatan dokumen langsung di ruang kerja Teams tanpa berpindah aplikasi. Integrasi ini membawa kemampuan agen riset AI ke dalam alur kerja kolaborasi enterprise.

Luma Luncurkan Agen Kreatif, Otomatiskan Ide Menjadi Sistem Iklan Lengkap

Luma Agents dapat secara otomatis menyelesaikan seluruh proses mulai dari perencanaan, pembuatan, hingga pengoptimalan berulang seputar konsep yang ditentukan pengguna. Cukup tetapkan konsep dan arah estetika, agen akan mengubah ide kreatif menjadi sistem periklanan yang lengkap — mencakup papan proposal klien, aset kampanye, dan iterasi berbasis umpan balik.

Menyebut ekstraksi sinyal model melalui API yang di-jailbreak sebagai "serangan distilasi" menstigmatisasi teknik distilasi yang fundamental bagi difusi AI, riset akademik, dan ekosistem sumber terbuka.

— Nathan Lambert, Peneliti AI

DeepSeek-V4: Mixed Attention + Sparse MoE Kurangi KV Cache 90%

DeepSeek-V4 menggunakan arsitektur mixed attention dan sparse MoE, mengurangi cache KV hingga 90% untuk mendukung panjang konteks satu juta token. Lompatan signifikan dalam efisiensi inferensi model skala besar.

GB300 Ultra NVL72 Bocor: 2,7x Lebih Cepat dari GB200

SemiAnalysis melaporkan bahwa GB300 Ultra NVL72 2,7 kali lebih cepat daripada GB200 NVL72 pada tolok ukur inferensi standar industri, menandai lompatan kinerja generasi hardware AI berikutnya.

nanowhale: Model DeepSeek Kecil Dilatih Sepenuhnya oleh Agen

Terinspirasi oleh nanochat milik Karpathy, nanowhale adalah model DeepSeek kecil yang sepenuhnya dilatih oleh agen ML, menunjukkan arah baru dalam pelatihan model otomatis tanpa campur tangan manusia.

NVIDIA: AI adalah Kue Lima Lapis — Energi, Chip, Infrastruktur, Model, Aplikasi

NVIDIA menegaskan bahwa negara dan perusahaan yang mampu membangun tumpukan penuh AI — dari energi hingga aplikasi — akan mendefinisikan era industri berikutnya.

François Chollet Umumkan Deep Learning with Python Gratis Online

Buku yang telah terjual 120.000 eksemplar dan membantu puluhan ribu orang memulai karir AI kini tersedia gratis secara online untuk dibaca oleh jutaan pembelajar di seluruh dunia.

Web2BigTable: Sistem Multi-Agen Dua Tingkat untuk Ekstraksi Skala Internet

Framework dengan orkestrator tingkat atas dan agen pekerja paralel, menggunakan loop jalankan-verifikasi-refleksi untuk pencarian web dan ekstraksi tabel. Avg@4 mencapai 38,50 di WideSearch.

UniVidX: Framework Multimodal Terpadu untuk Generasi Video Serbaguna

Menggunakan diffusion prior dengan masking kondisional acak dan decoupled gated LoRA, mencapai SOTA pada generasi video RGB dan komposisi lapisan RGBA.

IBM Granite 4.1-8B Dirilis, Dioptimalkan untuk VRAM 8-16GB

Model IBM Granite 4.1-8B diluncurkan di Hugging Face sebagai sumber terbuka, dirancang untuk berjalan efisien pada perangkat keras konsumen dengan VRAM terbatas.

MathArena: Platform Evaluasi Matematika untuk LLM Melampaui Benchmark Statis

MathArena memperkenalkan platform evaluasi dinamis untuk kemampuan matematika LLM, mengatasi keterbatasan benchmark statis yang rentan terhadap overfitting dan kebocoran data.

XGrammar-2: Generasi Terstruktur untuk Framework Agen Kompleks

Mendukung format tool-calling ketat dengan integrasi DeepSeek bawaan, memperkuat keandalan agen dalam mengeksekusi panggilan alat terstruktur.

Grok 4.3 Hasilkan Game Lengkap dengan Satu Prompt

Demo menunjukkan Grok 4.3 membangun game utuh dari satu prompt, dengan kecepatan output token melampaui Claude Sonnet dalam pengujian komunitas.

Konfigurasi Qwen 3.6: TPS Tinggi Hanya dengan VRAM 12GB

Komunitas berbagi konfigurasi Qwen 3.6 yang memungkinkan inferensi cepat pada perangkat keras terbatas, memperluas akses ke model besar.

Replit Luncurkan Pembuatan Pitch Deck Otomatis dengan AI

Deskripsikan kebutuhan, iterasi dalam chat, edit visual, lalu ekspor ke PPTX, Google Slides, atau PDF — tanpa menyentuh satu slide pun secara manual.

AI untuk Pendidikan: Platform Multimodal bagi Siswa Tunarungu

Platform pembelajaran multimodal berbasis AI membantu siswa tunarungu mengakses materi pendidikan melalui antarmuka yang adaptif dan inklusif.

Paralelisme Agen di Replit Lampaui Platform Mana Pun

CEO Replit Amjad Masad: 10 agen aktif, 198 draft, 700+ selesai — tingkat paralelisme agentik tertinggi yang terjadi di internet saat ini.

Mengapa Model Konteks 1 Juta Token Sejati Belum Ada?

Infrastruktur sudah jauh di depan sains: Claude bahkan menghentikan dukungan konteks 1M+ karena tidak berfungsi baik di atas ~200K token. Mungkinkah data atau teknik pelatihan yang kurang?

Claude 4.7 Jelaskan Asal-Usul Prompt Injection dengan Akurat

LLM mereproduksi detail historis prompt injection, termasuk tweet spesifik yang mendemonstrasikan trik yang mengecoh LLM state-of-the-art saat itu.

Jack Clark: Peluang 60% RSI Tercapai pada Akhir 2028

Co-founder Anthropic memberikan prediksi tentang Recursive Self-Improvement — tonggak penting dalam perdebatan keamanan dan kecepatan perkembangan AI.

Alat Visualisasi Model Hugging Face Diluncurkan

Masukkan URL model dan jelajahi arsitektur di granularitas apa pun tanpa perlu konfigurasi lokal atau notebook.

Bisakah Agen Koding Sumber Terbuka Menandingi Claude Code?

Studi menguji apakah agen kode open-weight plus harness dapat menyamai Claude Code dalam melatih model domain-spesifik dari satu prompt yang sama.

Paper Terbaik Minggu Ini: Agen Rekursif dan Pemodelan Dunia Agentik

Hugging Papers merangkum riset terdepan tentang sistem multi-agen rekursif, pemodelan dunia berbasis agen, dan organisasi AI.

Mungkin perangkat lunak adalah cache dari agen. Agen sudah bisa melakukan banyak tugas individual. Kita hanya memutuskan untuk menyimpan beberapa alur kerja yang terbukti dalam logika perangkat lunak.

— @hyhieu226

Gradien Transformer Bersifat Sparse

Eksplorasi gradien Transformer menunjukkan sifat sparse yang membuka potensi pendekatan low-rank untuk pelatihan yang lebih efisien.

Fitur CLC Work Stealing yang Mempercepat CUDA

Blog mendalam mengupas mekanisme work stealing yang secara halus namun signifikan meningkatkan kecepatan eksekusi CUDA.

Dataset Hugging Face Kini Dukung Format Parquet

Dukungan format Parquet memudahkan pemrosesan dataset skala besar secara efisien di ekosistem Hugging Face.

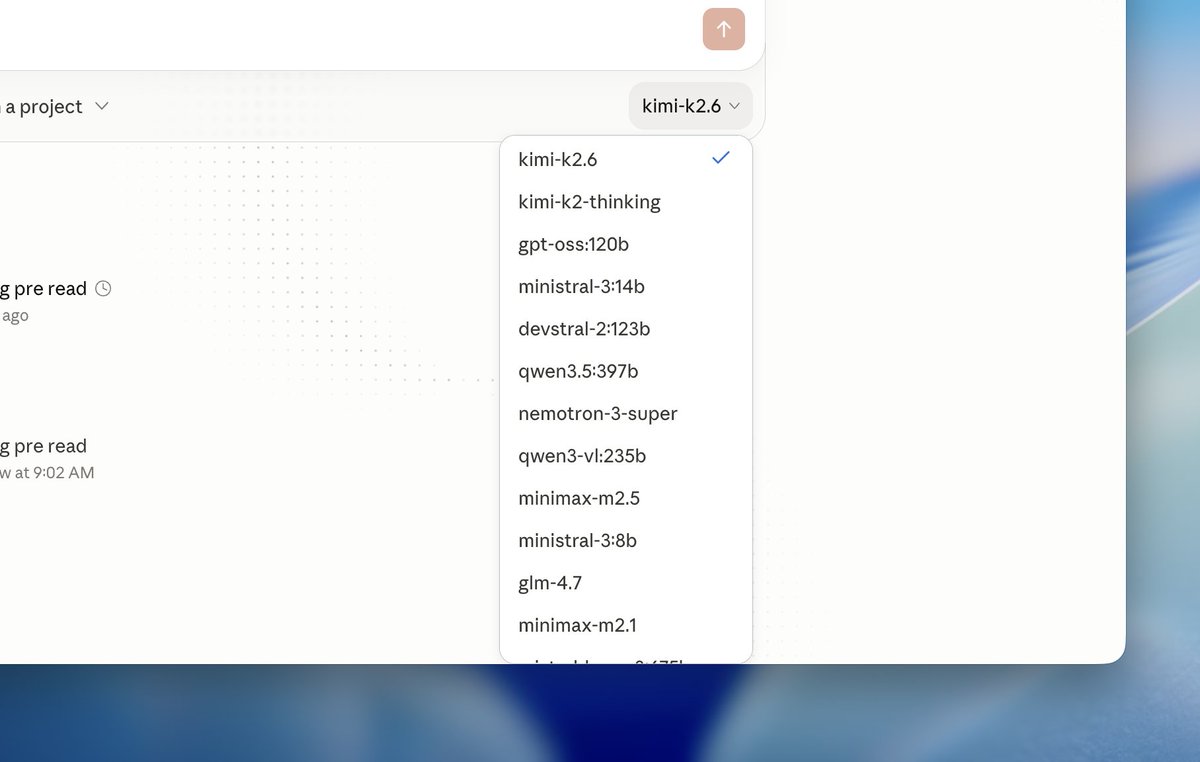

Model Open Source Trending: DeepSeek, Xiaomi, OpenAI

Model dari DeepSeek, Xiaomi, OpenAI, Mistral AI, dan AI Pool mendominasi tren minggu ini di Hugging Face.

Codex: 10x Eksperimen, 50% Lebih Produktif

Dengan Codex, pengguna menjalankan 10x lebih banyak eksperimen — namun hanya 15% hasil yang sepenuhnya dapat dipercaya. Tetap menghasilkan peningkatan produktivitas bersih 50%.