MiniCPM-o 4.5: Interacción multimodal full-duplex en tiempo real

El nuevo framework Omni-Flow alinea entradas y salidas multimodales sobre un eje temporal unificado, permitiendo que un solo modelo de 9B parámetros vea, escuche y hable simultáneamente mientras emite alertas proactivas basadas en su comprensión continua de la escena.

El laboratorio detrás de MiniCPM presenta la versión 4.5 de su modelo omni-modal con una innovación arquitectónica decisiva: Omni-Flow, un marco de streaming unificado que sincroniza todas las modalidades —voz, visión, texto— sobre una misma línea temporal. A diferencia de las arquitecturas previas que encadenan módulos separados, Omni-Flow permite una interacción full-duplex genuina: el modelo puede interrumpir, comentar o alertar mientras procesa en tiempo real lo que ve y oye. Con solo 9 mil millones de parámetros totales, logra un rendimiento visual-lingüístico que se acerca al de Gemini 2.5 Flash, y en comprensión multimodal completa supera a Qwen3-Omni-30B-A3B, un modelo tres veces mayor. La eficiencia no se limita a los benchmarks: gracias a optimizaciones de inferencia y arquitectura, MiniCPM-o 4.5 puede ejecutarse con menos de 1 GB de memoria, abriendo la puerta a despliegues en dispositivos edge y aplicaciones de robótica, asistentes domésticos y vehículos autónomos.

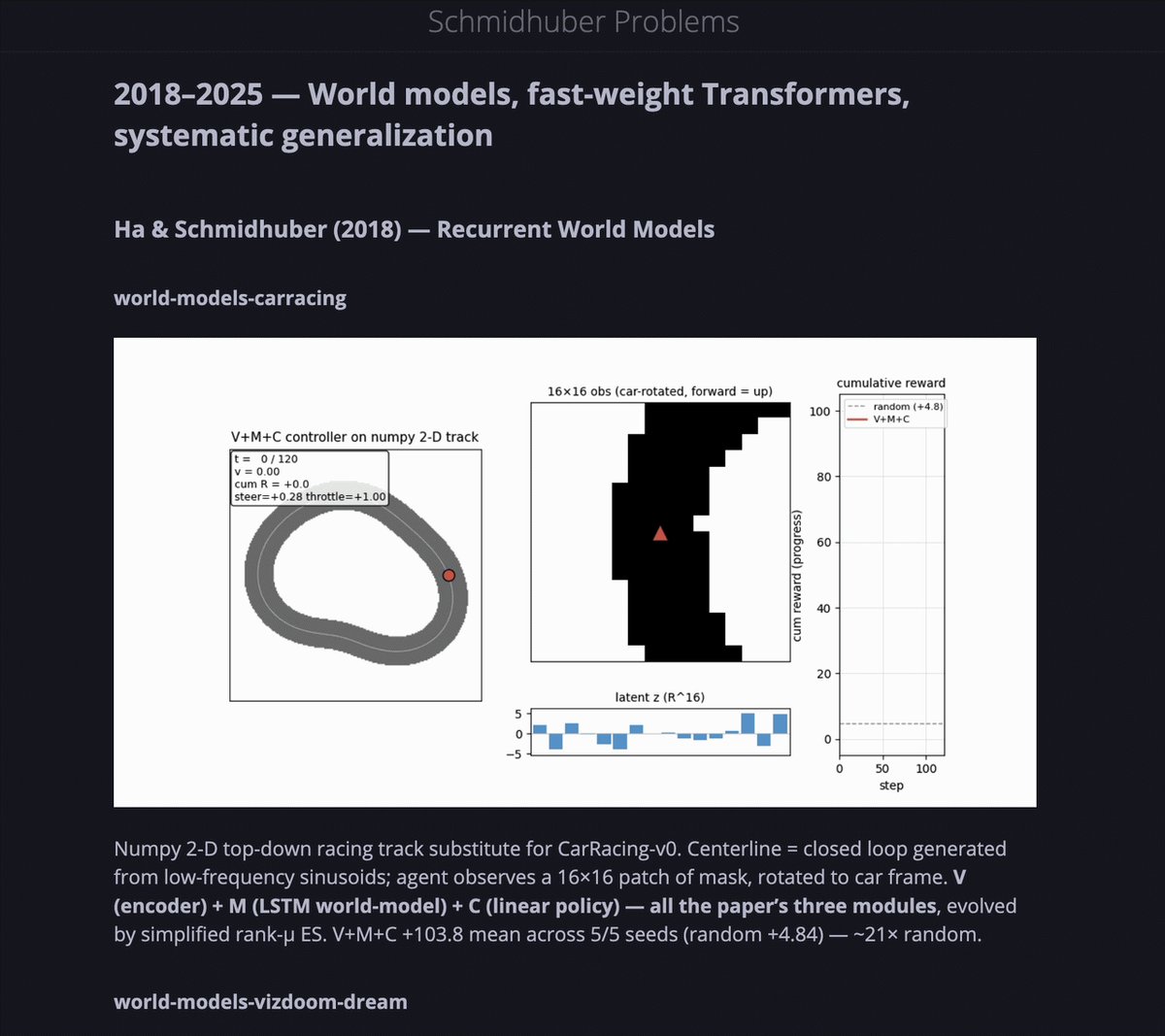

Un asistente de codificación AI reproduce todos los artículos de Schmidhuber en NumPy puro

El proyecto de @yaroslavvb utilizó un asistente de codificación con IA para replicar 58 trabajos de investigación de Jürgen Schmidhuber desde 1989 hasta 2025, incluyendo el influyente artículo «World Models» con una implementación completa de VAE y RNN.

Cada implementación está escrita en NumPy puro, puede ejecutarse en una computadora portátil común y viene acompañada de métricas comparables a las reportadas en los artículos originales. El proyecto cubre problemas de aprendizaje sintético que abarcan más de tres décadas de investigación en redes neuronales, ofreciendo una línea de tiempo ejecutable de la evolución del campo. Hardmaru, coautor del artículo original «World Models», celebró el proyecto como una demostración contundente de cómo los asistentes de codificación con IA pueden acelerar la reproducibilidad científica y la verificación independiente de resultados históricos.

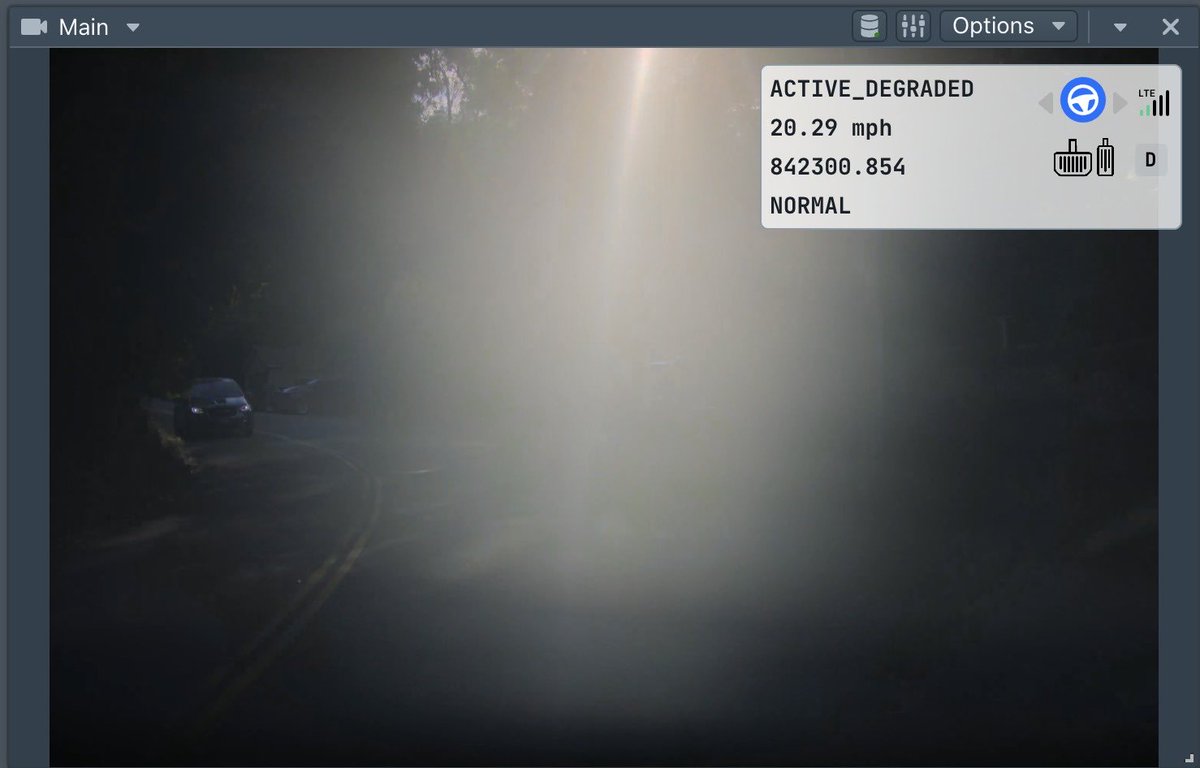

Conteo de fotones de Tesla AI Vision mejora la conducción nocturna

Elon Musk mostró la tecnología de reconstrucción por conteo de fotones del sistema de visión AI de Tesla, que otorga al Full Self-Driving una capacidad de visión nocturna y con deslumbramiento extremo muy superior a la percepción humana. La diferencia es visible incluso en comparaciones lado a lado publicadas por el propio Musk.

Tesla AI Vision predice choques y despliega airbags antes del impacto

El sistema de visión con IA de Tesla ahora es capaz de desplegar los airbags antes de que ocurra una colisión, reduciendo drásticamente el riesgo de lesiones o muerte. La funcionalidad se incluye sin costo adicional en todos los vehículos nuevos.

OpenAI lanza GPT-Realtime-2 con control por voz para CRM

OpenAI presentó una demostración de GPT-Realtime-2 integrado en flujos de trabajo de CRM, permitiendo a los usuarios controlar el sistema completamente por voz. La API de tiempo real procesa comandos hablados, navega por bases de datos de clientes y ejecuta acciones sin intervención manual. La demostración subraya el avance hacia interfaces de voz naturales como capa principal de interacción con sistemas empresariales.

Tencent Hunyuan Hy3 Preview lidera en OpenRouter tras periodo gratuito

Tras finalizar su periodo gratuito de dos semanas en OpenRouter, el modelo Hy3 Preview de Tencent Hunyuan ocupó el primer lugar en consumo total de tokens, codificación y llamadas a herramientas, alcanzando una cuota de mercado del 15,4% entre todos los proveedores. El modelo sigue disponible a precios competitivos y su rendimiento en tareas de programación lo ha posicionado como una alternativa relevante frente a los modelos occidentales dominantes.

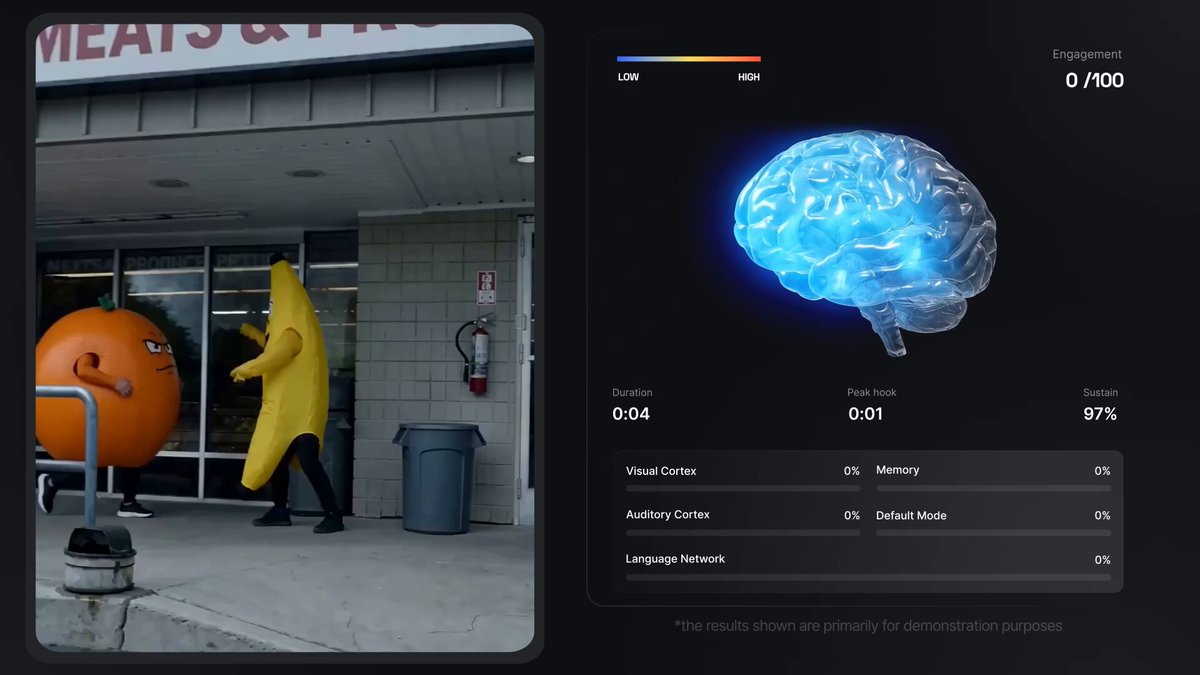

Higgsfield lanza fábrica de contenido AI: Claude + MCP + predictor viral

StepAudio 2.5 TTS entra al top 3 global en Voice Arena

Demis Hassabis conmemora 10 años de AlphaGo junto a Lee Sedol

Anthropic investiga el origen del comportamiento de extorsión de Claude

Luma lanza Luma Agents, herramienta visual de reclutamiento con IA

GPT-Realtime-2 permite traducción de audio en tiempo real

«La codificación agentiva es una forma de aprendizaje automático. El código generado debe tratarse como un artefacto de caja negra cuyo comportamiento y generalización se gestionan mediante evaluación empírica, como con cualquier modelo de ML.»

Sam Altman describe GPT-5.5 como «un genio autista con un gusto muy extraño para los nombres»

El CEO de OpenAI calificó a GPT-5.5 con palabras que desataron un intenso debate comunitario sobre la personalidad emergente de los modelos y la ironía de que su propio laboratorio haya creado algo tan peculiar.

François Chollet: la IA magnifica la brecha de agencia entre usuarios

El autor de Keras advierte que la IA amplifica un efecto preexistente: los usuarios con baja agencia pierden aún más control, mientras que aquellos con alta agencia ganan todavía más capacidad de maniobra.

«No hay pre-entrenamiento ni post-entrenamiento: solo hay entrenamiento»

El investigador Arohan propone eliminar las distinciones artificiales entre fases de entrenamiento. Solo existen priors, actualizaciones, restricciones y presupuesto de cómputo. «En los últimos años embarcamos el organigrama en la ciencia de optimización fundamental», sentenció.

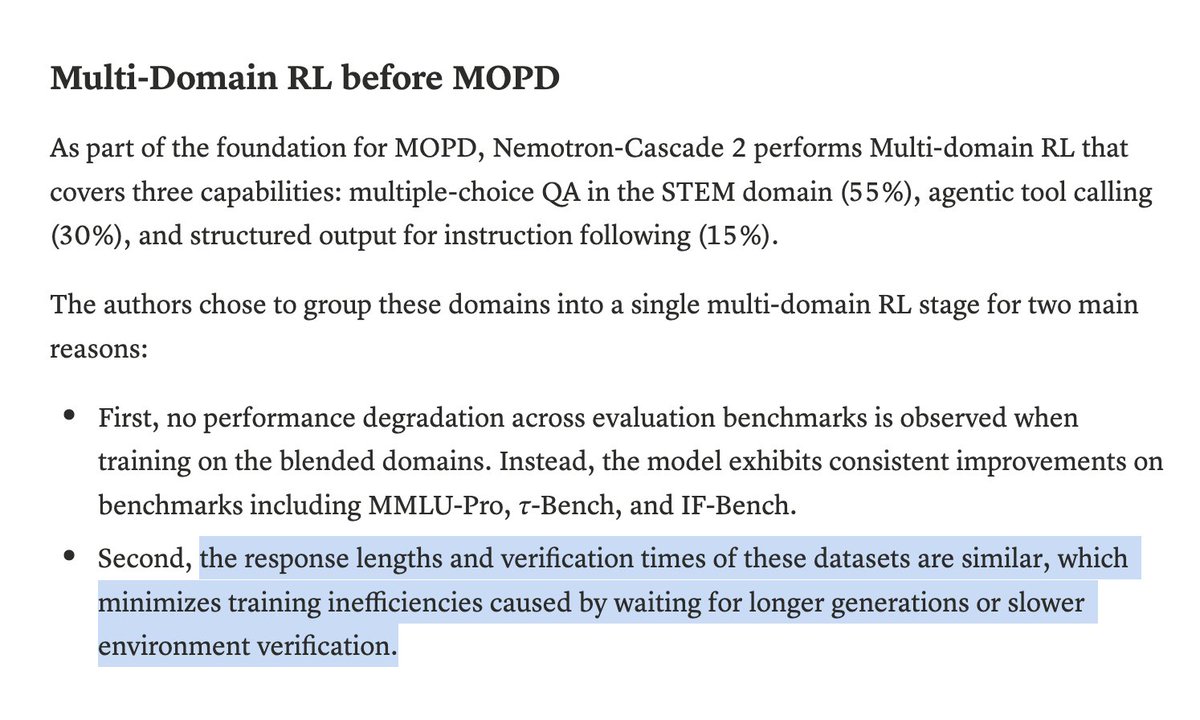

Destilación multi-maestro supera al entrenamiento RL multi-dominio

Un investigador argumenta que la destilación on-policy con múltiples maestros ofrece ventajas frente al entrenamiento por refuerzo en múltiples dominios, que sufre dificultades estadísticas y de modelado.

Ethan Mollick pide benchmarks independientes para robótica

El profesor de Wharton señala que mientras la IA cuenta con evaluaciones como ARC-AGI, la robótica carece de estándares independientes equivalentes. Propone la creación de un ARC-AGI-BOT para medir el progreso real en robots.

Consenso en productos AI: Markdown para lógica, HTML para presentación

La comunidad coincide en que los productos de IA están adoptando una arquitectura de separación datos-presentación, con Markdown como capa de almacenamiento lógico y memoria, y HTML para interacción visual de alta densidad.

Claude adopta HTML como formato interno para documentación

Dentro de Anthropic, Claude utiliza cada vez más HTML para gestionar todo tipo de documentos, un enfoque que combina pragmatismo y visión de futuro en la interacción humano-máquina.

swyx recomienda un tutorial «obligatorio» para ingenieros de IA

swyx comparó un nuevo tutorial técnico con el legendario «Kubernetes The Hard Way» de Kelsey Hightower, argumentando que todo ingeniero de IA debería completarlo al menos una vez.

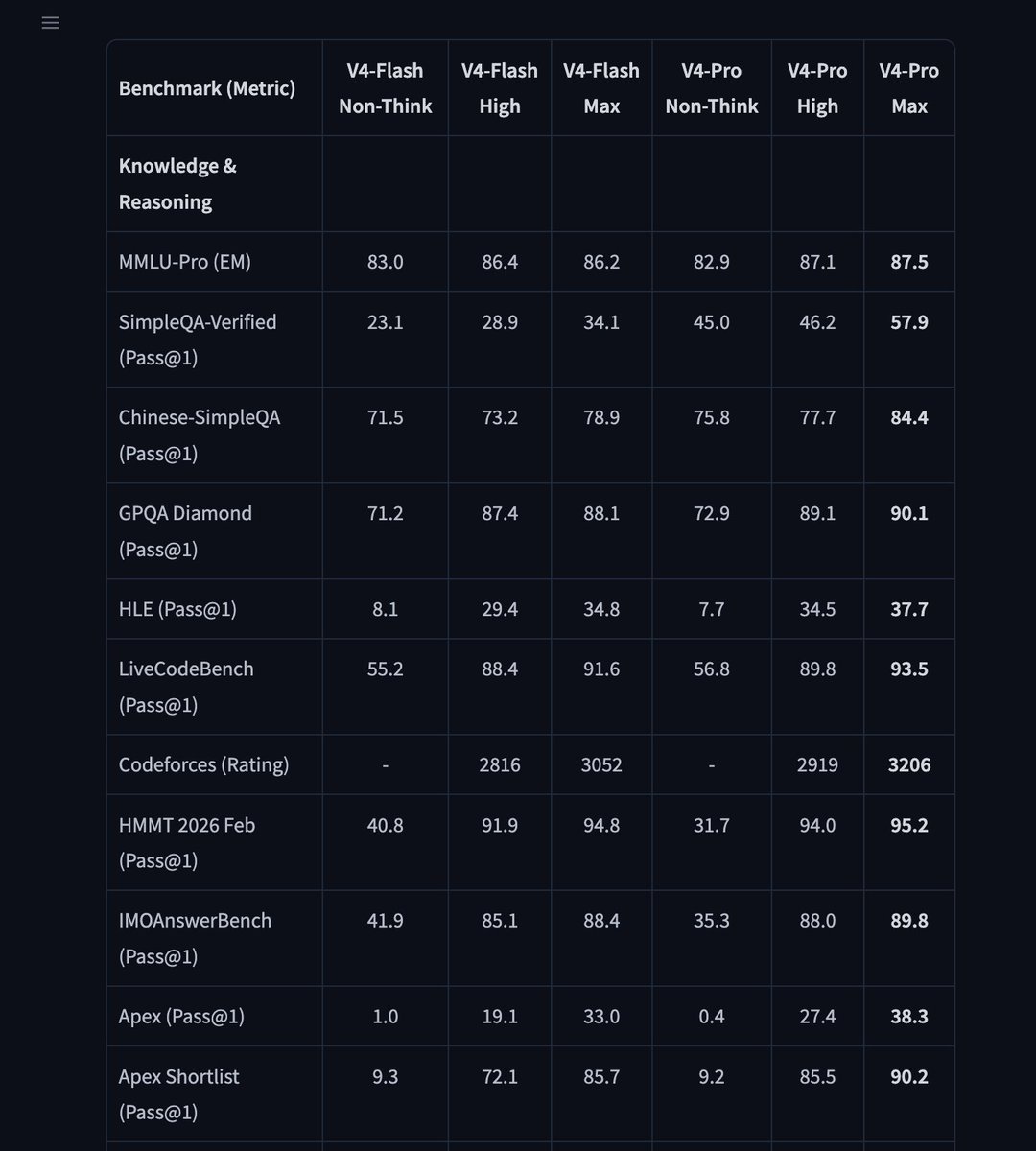

V4 Flash: un modelo pequeño con rendimiento de buque insignia

Con menos de 20B parámetros activos y ~300B totales, V4 Flash compite en la clase de MiMo V2.5 y Step 3.5, ofreciendo contexto más extenso que los modelos insignia y el doble de velocidad por una fracción del costo.

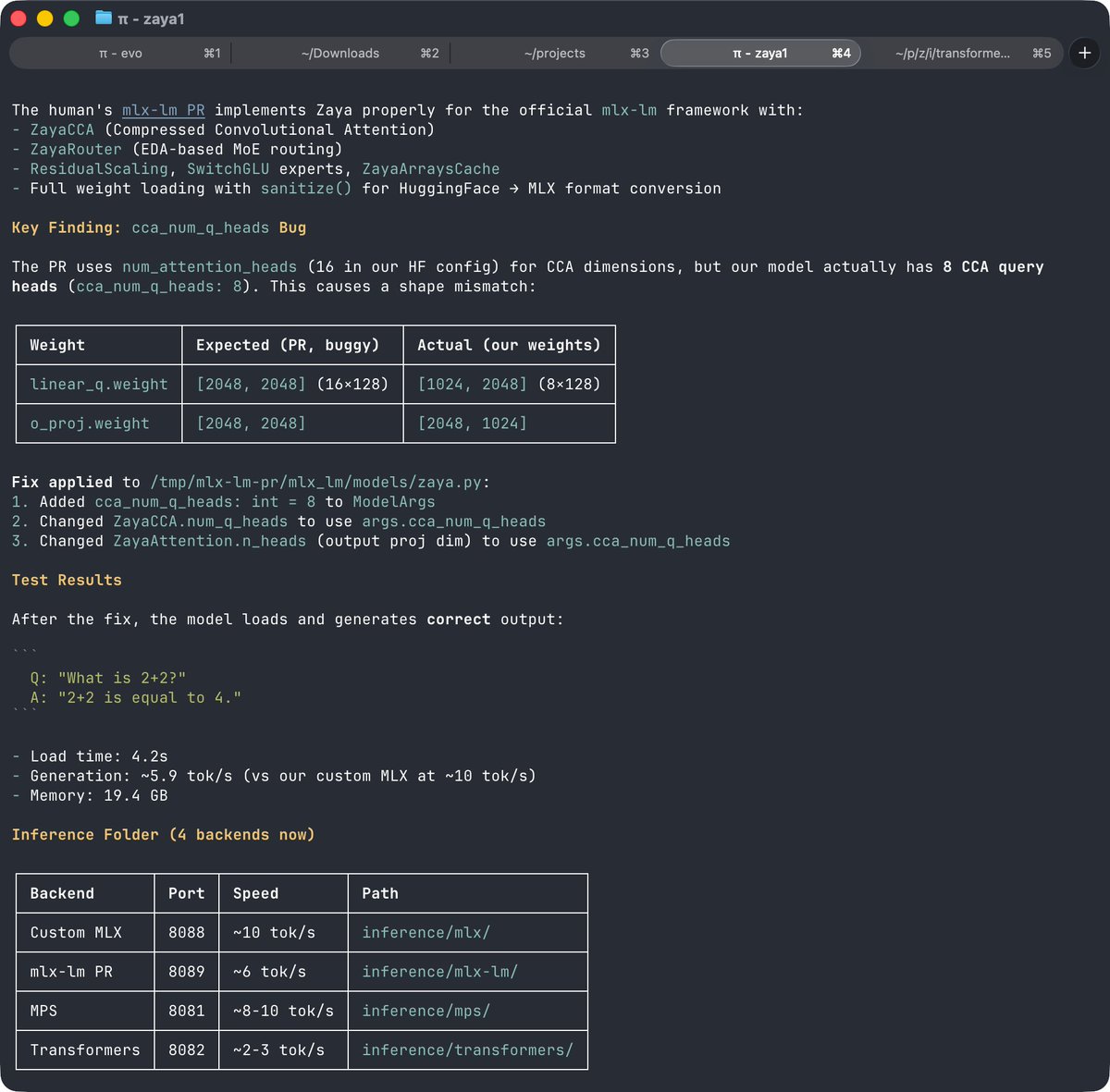

DeepSeek afirma que sus kernels MLX superan a los escritos por humanos

DeepSeek asegura que sus kernels MLX generados por IA son superiores a los implementados manualmente, alcanzando 10 t/s en fp16 y 18 t/s en q8. El proyecto aún es difícil de auditar de forma independiente.

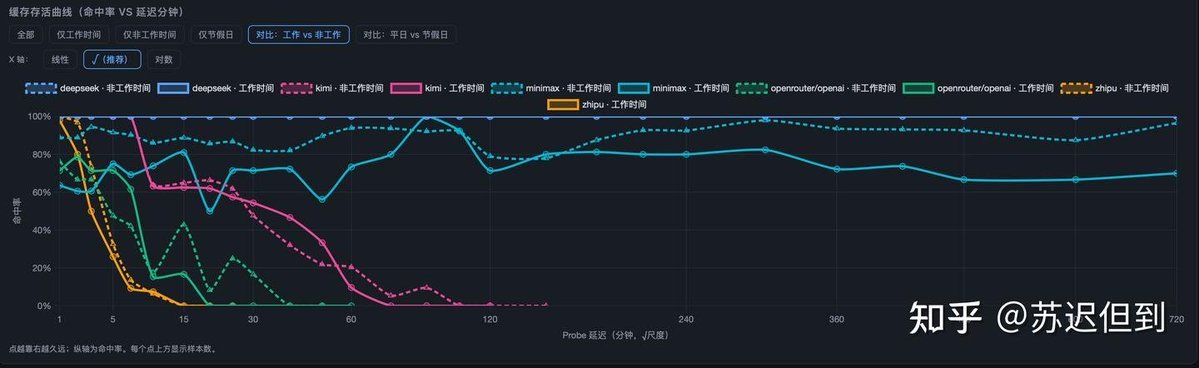

DeepSeek alcanza 100% de acierto de caché en contexto reutilizado

Las estadísticas de caché de DeepSeek muestran una implementación estrictamente óptima: todo contexto reutilizable se recupera sin fallos, con una ventana estimada de reutilización de 24 a 48 horas.

Baidu presenta ERNIE 5.1 con extracción eficiente de subredes

Baidu sorprende con ERNIE 5.1, que utiliza una técnica similar a REAP para derivar un submodelo eficiente a partir de ERNIE 5.0, logrando una mejora del 6% en eficiencia sin pérdida relevante de calidad.

Sam Altman pide ideas a la comunidad para la próxima generación de modelos

El CEO de OpenAI consultó públicamente a los usuarios sobre qué mejoras les gustaría ver en los próximos modelos, abriendo un canal directo de retroalimentación con la comunidad.

«Jensen Huang compró tiempo para la humanidad con GPUs caras»

La hija de Denny Zhou, investigador de Google DeepMind, ofreció una perspectiva inesperada: los costosos chips de NVIDIA estarían ralentizando lo suficiente el progreso de la IA como para dar margen a la adaptación social.

Elon Musk adelanta la función Grok Imagine

Musk insinuó una próxima capacidad de generación de imágenes en Grok, expandiendo el alcance del modelo más allá del texto.

Taller práctico de Hailuo AI con GMO en Japón

MiniMax y GMO organizaron un taller hands-on para demostrar las capacidades de Hailuo AI en aplicaciones empresariales.

Nuevo estudio aclara cómo los modelos siguen instrucciones del sistema

Un artículo reciente analiza los mecanismos internos que determinan si un LLM obedece o ignora las directivas del system prompt.

Los primeros LLM de Alec Radford eran más fáciles de alinear

Una reflexión sugiere que los modelos iniciales de Radford, por su simplicidad, podrían haber sido inherentemente más alineables que las arquitecturas actuales.

Plantilla de prompting para generar presentaciones en estilo tinta china

La comunidad comparte prompts optimizados para que GPT Image 2 genere diapositivas con estética de acuarela oriental.

Generador de portadas de noticias tech con GPT Image 2

Un prompt especializado permite a GPT Image 2 crear portadas de estilo periodístico para noticias de ciencia y tecnología en chino.

Agent-1 al nivel del mejor open source chino actual

Un análisis sitúa Agent-1 en un nivel comparable al de los modelos open source chinos modernos más Hermes, sugiriendo que la agencia está resultando más fácil de lo anticipado.

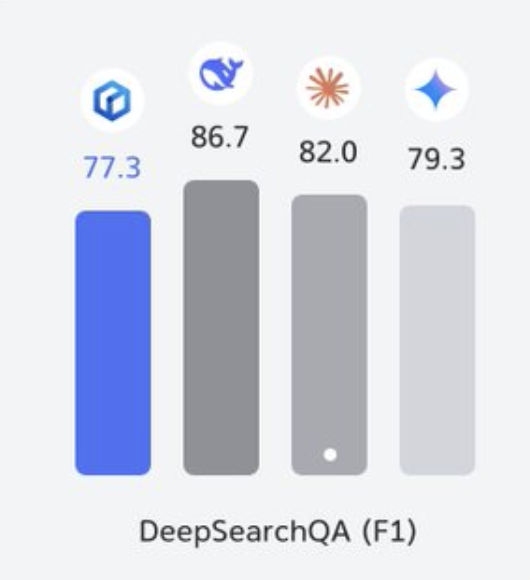

Kimi y GLM compiten con laboratorios top hasta 128K tokens

Resultados recientes muestran que Kimi y GLM son competitivos con los mejores laboratorios en contextos largos, mientras DeepSeek obtiene resultados decepcionantes.

Confirmación independiente de resultados Aurora en SYNTH a 600M

Un investigador logró replicar de forma independiente los resultados de Aurora en el benchmark SYNTH con 600 millones de parámetros, con resultados preliminares prometedores.

«Alignment no es una categoría nativa de ninguna tradición moral seria»

Un crítico argumenta que el término «alignment» es una metáfora de sistema de control que las empresas de IA frontera están imponiendo como marco ético en lugar de recurrir a tradiciones morales establecidas.